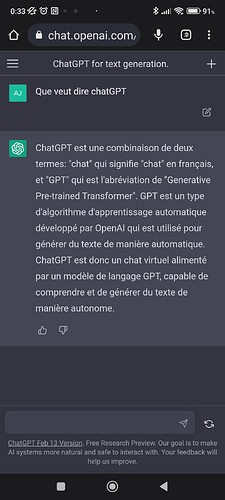

Ce matin j’ai fait un test sur ChatGPT. Après avoir créé mon compte, je lui ai donné un texte que Jeedom formate tous les matins au petit déjeuner. Il est ensuite lu par un Google Home. Le texte est un extrait fautes comprises car j’ai adapté le texte rapidos vers ChatGPT, j’ai même oublié d’enlever une commande (round 7) qu’il a corrigé.

Je vous en fichier joint « Textes ChatGPT.txt » le résultat du dialogue.

Textes ChatGPT.txt (17,1 Ko)

Je suis bluffé par le texte généré avec un bémol tout de même, certaines informations passent à la trappe. Mais ça serait super de générer un texte différent tous les matin à la manière de…

Le top pour moi c’est le présentateur qui fait des blagues : Mais bon, c’est l’occasion de sortir vos jolis parapluies et de jouer les Mary Poppins ! ou la température de la salle de bain est également de 19 degrés. Eh oui, ça ne chauffe pas beaucoup mais c’est déjà mieux que de se prendre une averse glacée sur la tête, non ? Je pense qu’il a fait un mélange entre la température de la pièce et la température de l’eau de la douche.

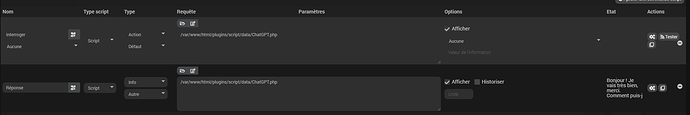

Bon, voilà, Il ne reste plus qu’à connecter Jeedom à l’API de ChatGPT. Injecter le texte généré par Jeedom vers ChatGPT, le récupérer puis le donne au Google Home, facile…  Si une personne y est arrivée je suis preneur.

Si une personne y est arrivée je suis preneur.

Pour les curieux voici le texte brut tiré du script Jeddom. J’utilise les plugins Météo France, Vigilance Météo, Google cast et PlayTTS. Certaines tournures sont adaptées pour que texte paraisse plus naturel à l’écoute, Google Home mettant sa sauce pour certains mots surtout les nombres.

message=« Bonjour, j’espère que vous avez bien dormi. On est le #sday# #day# #smonth#, il est formatTime(#time#). Actuellement la température extérieure est de round(#[DOMUS][Température][Extérieur]#) degrés avec un taux d’humidité de #[DOMUS][Hygrométrie][Extérieur]# pour cent. La température maximale aujourd’hui sera de round(#[Aucun][Météo][Météo du Jour - Aujourdhui - Température Maximum]#) degrés sous une condition d’#[Aucun][Météo][Météo du Jour - Aujourdhui - Description]#. La température du séjour est de str_replace(‹ . ›,’ virgule ‹ ,#[DOMUS][Température][Appartement]#) degrés avec un taux d’humidité de #[DOMUS][Hygrométrie][Appartement]# pour cent. La température de la salle de bain est de str_replace( ›.‹ , › virgule ',#[DOMUS][Température][Salle de bain]#)) degrés. Coté plage. #[CONTRÔLE][Home Blabla][Marée]#) avec un coefficient de #[CONTRÔLE][Marée][Indicateur Marée]# sous une condition de #[Aucun][Météo][Marine - Mer condition texte]#. En ce moment, la température de l’eau est de round(#[Aucun][Météo][Marine - Température eau]#) degrés avec des vagues de #[CONTRÔLE][Home Blabla][Hauteur vagues]#. L’indice uv sur la plage sera de #[Aucun][Météo][Météo du Jour - Aujourdhui - Indice UV]# ce jour. Enfin, avec un vent de #[Aucun][Météo][Météo du Jour - Aujourdhui - Vitesse du Vent]# kilomètrheures la température ressentie sera de round(#[Aucun][Météo][Météo du Jour - H+1 - Température Ressentie]#) degrés. Aujourd’hui La lunaison sera dans un état de #[Aucun][Météo][Ephéméride - Lune phase description]# et nous fêterons la #[Aucun][Météo][Ephéméride - Saint du jour]#. Voilà c’est tout pour ce matin, je vous souhaite une bonne et agréable journée. »

#[CONTRÔLE][Home Blabla][Marée]# est un autre script généré à chaque marée suivant les situations :

la marée est entrain de descendre. La basse mer sera à formatTime(#[CONTRÔLE][Marée][Basse Mer]#)

ou

la marée est entrain de monter. La pleine mer sera à formatTime(#[CONTRÔLE][Marée][Pleine Mer]#)

ou 10 minutes pendant un changement de marée :

c’est la pleine mer, la marée est entrain de descendre. Elle sera au plus bas à formatTime(#[CONTRÔLE][Marée][Basse Mer]#)

ou

c’est la basse mer, la marée est entrain de monter. Elle sera au plus haut à formatTime(#[CONTRÔLE][Marée][Pleine Mer]#)

et enfin #[CONTRÔLE][Home Blabla][Hauteur vagues]# pour gérer l’arrondi de la hauteur :

floor(#[Aucun][Météo][Marine - Vagues hauteur]#) mètres

ou

str_replace(‹ . ›,’ mètres ',#[Aucun][Météo][Marine - Vagues hauteur]#)0

Le zéro en final pour donner par exemple : trois mètres quarante