Hello.

Je suis tombé sur cette vidéo

Projet de detecteur de son / clap via IA.

C’est assez prometteur de pouvoir déclencher des actions par reconnaissance de son.

Y aurait il un début de reflexion sur Jeedom à ce sujet ?

Hello.

Je suis tombé sur cette vidéo

Projet de detecteur de son / clap via IA.

C’est assez prometteur de pouvoir déclencher des actions par reconnaissance de son.

Y aurait il un début de reflexion sur Jeedom à ce sujet ?

Salut

C’est une super intégration mais pour jeedom ça va être compliquée de l’adapter…

En fouillant les issues il y a une demande docker qui pourrait nous être utilisé s’il l’accepte

Tout ce que peux faire HA , Jeedom peux le faire, enfin j’espère

Oui mais faut l’adapter donc savoir développer et de trouver un dev qui veut le faire

en réalité il y a peu de code lié à HA dans le github.

ce ne serait pas très compliqué pour celui qui voudrait le mettre dans un plugin jeedom.

après faut voir les cas d’usage/utilité vs dev+maintenance.

mais je suppose qu’il y aura bien un dev qui se servira de ce « claper » et en fera un plugin ![]()

Note: détection de sons à base d’IA Tensorflow (Yamnet), rien à voir avec les GPT et autres IA génératives.

J’y trouve peu d’utilité de mon coté (pour mon utilisation en tout cas) mis à part pourquoi pas de la détection de bris de glace…

Car sinon:

Mais il y a sans doute des cas d’usages pertinents, curieux de voir comment les gens vont s’en servir. Les clapers, c’est vieux comme Hérode, je jouais avec ça (en plus basique, un peu d’élec avec un micro, une LED etc) quand j’étais ado (dans les années 90).

ce qui m’interesse c’est les aboiements.

j’ai testé avec Frigate, et c’est tres aléatoire avec beaucoups de faux positifs…

via ce dockercompose, j’ai pu installer sur un lxc. https://hub.docker.com/r/k4n71/claptrap

maintenant je me demande comment communiquer avec jeedom…

dans le flux rtsp j’ai mis ma caméra qui a un micro. mais le webhook c’est quoi?

mais il y a des erreurs dans les logs

`0000 00:00:1736885474.571684 454 task_runner.cc:85] GPU suport is not available: INTERNAL: ; RET_CHECK failure (mediapipe/gpu/gl_context_egl.cc:77) display != EGL_NO_DISPLAYeglGetDisplay() returned error 0x300c

2025-01-14 20:11:14,580 - INFO - Classificateur audio initialisé avec succès (sample_rate: 16000Hz)

2025-01-14 20:11:14,580 - INFO - Options du classificateur: max_results=5, score_threshold=0.3

2025-01-14 20:11:14,581 - INFO - Source audio ajoutée: rtsp_rtsp://admin:NIHVTP@192.168.1.80/H.264 (ID interne: 1)

2025-01-14 20:11:14,581 - INFO - Task runner MediaPipe démarré avec succès

2025-01-14 20:11:14,581 - INFO - Détection démarrée pour la source RTSP rtsp_rtsp://admin:NIHVTP@192.168.1.80/H.264

2025-01-14 20:11:14,581 - ERROR - Erreur lors de la lecture RTSP: module 'ffmpeg' has no attribute 'input'

2025-01-14 20:11:14,581 - ERROR - Erreur dans le traitement audio: object of type 'NoneType' has no len()

2025-01-14 20:11:14,581 - ERROR - Traceback (most recent call last):

File "/claptrap/data/audio_detector.py", line 168, in process_audio

if len(audio_data) > self.buffer_size:

TypeError: object of type 'NoneType' has no len()

2025-01-14 20:11:14,581 - ERROR - Erreur dans run_detection: local variable 'process' referenced before assignment`

Salut,

Ben j’ai pas encore fouillé tout le github mais j’ai vu la vidéo et de ce que j’en ait compris, la seule chose que fait l’intégration c’est appeler un webhook HA.

Au final sous Jedom tu as une API http donc clairement à appeller une URL HA ou une URL jeedom ça change pas grand chose.Pas besoin de développer un plugin spécifique; l’api http c’est du natif.

La seule chose que tu va devoir faire et qui est à priori native dans HA, c’est le mini scénario qui par exemple va gérer le toggle (si lumière éteinte l’allumer sinon l’éteindre). Mais ça c’est faisable en 3 lignes de scénario sous jeedom.

Cf https://doc.jeedom.com/fr_FR/core/4.4/api_http avec n’importe quel équipement qui est capable d’appeller une url, l’appel de http://#IP_JEEDOM#/core/api/jeeApi.php?apikey=#APIKEY#&type=scenario&id=#ID#&action=#ACTION# lancera le scénario jeedom correspondant.

Le webhook c’est l’url appelée par le plugin en cas de déclenchement et ça peut donc tout à fait être l’api de jeedom, cf mon message précédent.

super déjà un bon début

Moi les claps de main m’interesse, et aussi les bruits des différents appareils electroménager

Bip Lave vaisselle, Bip Machine à laver …

Enfin quand je reli le github des frères Poulain, toute l’intelligence est fait dans le plugin HA

Choix de la source des sons, reconnaissance via IA, génération du Webhook

Ok on peut envoyer un webhook à Jeedom mais comment on fait tout ce qu’il y a avant ? selection de la source, reconnaissance du bruit par IA

Et la reconnaissance de L’Atom Echo ?? dans Jeedom

Hello,

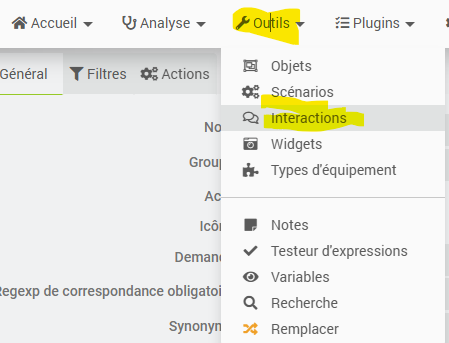

est-ce que via les interactions jeedom ça ne fonctionnerait pas ?